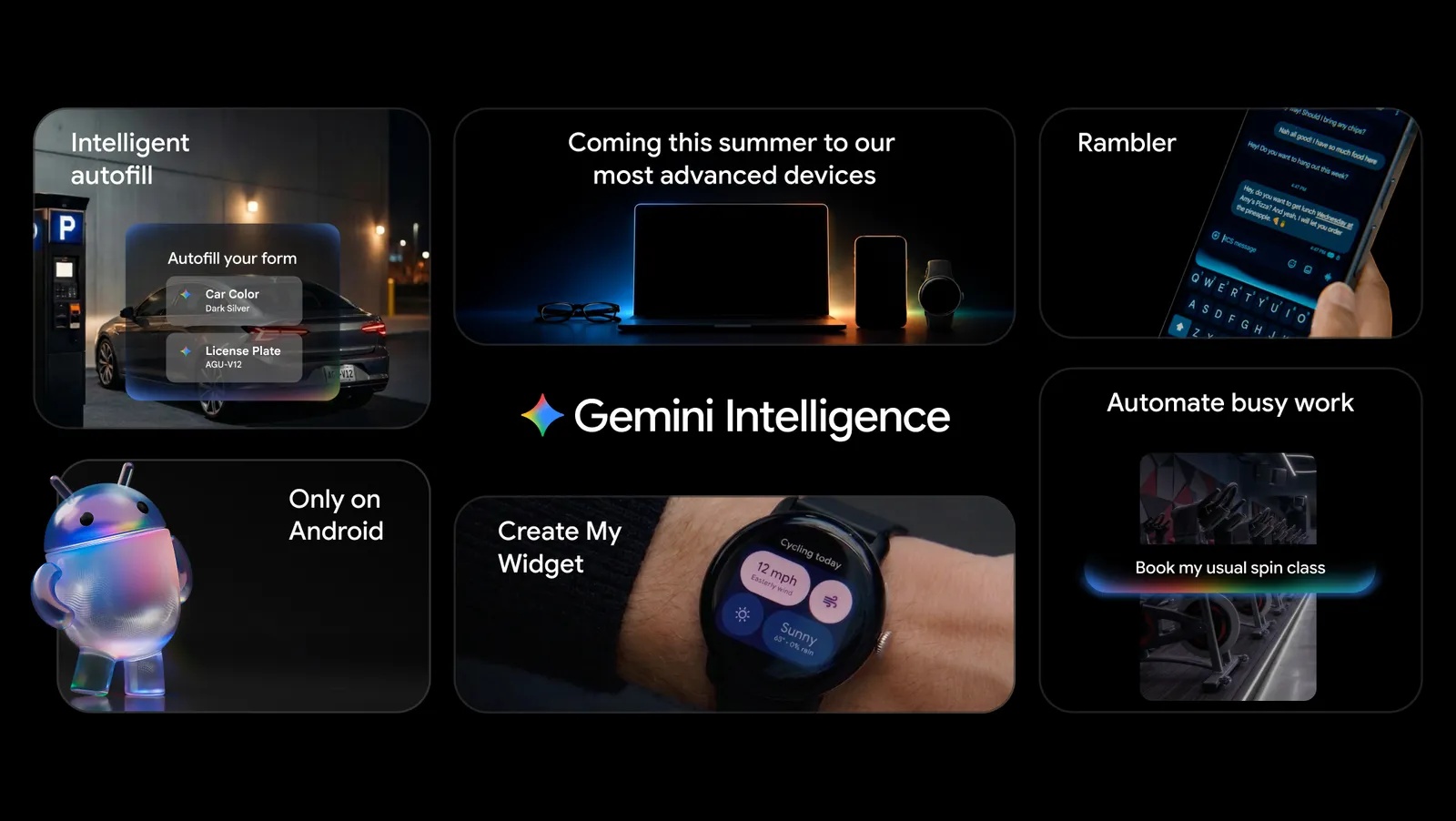

Google เปิดตัว “Gemini Intelligence” แนวคิดใหม่ที่เปลี่ยน Android จากระบบปฏิบัติการธรรมดา ไปสู่ระบบอัจฉริยะที่สามารถช่วยทำงานแทนผู้ใช้ได้แบบเชิงรุกมากขึ้น ทั้งการสั่งงานหลายแอปพร้อมกัน, กรอกฟอร์มอัตโนมัติ, สรุปข้อความเสียง, ช่วยท่องเว็บ และสร้าง Widget แบบ AI ได้เอง โดยจะเริ่มใช้งานบน Samsung Galaxy รุ่นใหม่และ Google Pixel ในช่วงฤดูร้อนปีนี้ ก่อนขยายไปยังอุปกรณ์ Android อื่นๆ ภายในปีเดียวกัน

ในบทความนี้

Android กำลังเปลี่ยนจาก “OS” เป็น “Intelligence System”

Google อธิบายว่า Android รุ่นใหม่จะไม่ได้เป็นแค่ระบบที่ “รอคำสั่ง” อีกต่อไป แต่จะกลายเป็นระบบที่ช่วยคาดการณ์ ช่วยจัดการ และทำงานแทนผู้ใช้ได้มากขึ้น ผ่านโมเดล Gemini ที่ถูกฝังอยู่ในตัวระบบโดยตรง

แนวคิดนี้ Google เรียกว่า “Gemini Intelligence” ซึ่งเป็นการรวมกันระหว่างฮาร์ดแวร์ระดับเรือธง และซอฟต์แวร์ AI ที่ทำงานร่วมกันแบบลึกกว่าเดิม โดยเน้น 3 เรื่องหลักคือ

• ช่วยลดงานจุกจิก

• ทำงานหลายขั้นตอนแทนผู้ใช้

• ยังคงควบคุมความเป็นส่วนตัวได้เอง

Google ระบุว่าฟีเจอร์ทั้งหมดจะยังอยู่ภายใต้การอนุญาตของผู้ใช้ และ AI จะหยุดทำงานทันทีเมื่อจบภารกิจที่สั่งไว้

Gemini จะ “กดแอปแทน” ผู้ใช้ได้มากขึ้น

หนึ่งในจุดสำคัญที่สุดของ Gemini Intelligence คือระบบ “Multi-step Automation” หรือการทำงานหลายขั้นตอนอัตโนมัติข้ามแอป

Google บอกว่าตลอดหลายเดือนที่ผ่านมา ได้ร่วมปรับแต่งระบบกับแอปยอดนิยมบน Galaxy S26 และ Pixel 10 เพื่อให้ AI สามารถเข้าใจลำดับการใช้งานจริงของมนุษย์ได้ดีขึ้น

ตัวอย่างที่ Google ยกมา เช่น

• จองจักรยานแถวหน้าในคลาสปั่น

• ค้นหา syllabus ใน Gmail

• เอาหนังสือที่ต้องใช้ใส่รถเข็นซื้อสินค้าให้อัตโนมัติ

• จองบริการผ่านแอปเดินทางหรือเดลิเวอรี

ทั้งหมดนี้ Gemini จะเป็นคนเปิดแอป, กรอกข้อมูล, ค้นหา และดำเนินการแทนผู้ใช้ โดยผู้ใช้มีหน้าที่ยืนยันขั้นตอนสุดท้ายเท่านั้น

นี่ถือเป็นทิศทางเดียวกับ “AI Agent” ที่หลายบริษัทกำลังผลักดัน แต่ Google ได้เปรียบตรงที่ Android เป็นระบบปฏิบัติการหลักของสมาร์ตโฟนทั่วโลก ทำให้สามารถฝัง AI เข้าระดับระบบได้โดยตรง

เข้าใจ “สิ่งที่อยู่บนหน้าจอ” และเปลี่ยนเป็นคำสั่งได้ทันที

อีกจุดที่น่าสนใจคือ Gemini Intelligence จะสามารถใช้ “ภาพบนหน้าจอ” หรือ “รูปถ่าย” เป็นบริบทในการทำงานได้

Google ยกตัวอย่างว่า หากผู้ใช้มีรายการซื้อของยาวๆ อยู่ในแอปโน้ต เพียงกดปุ่ม Power ค้าง แล้วสั่ง Gemini ให้สร้างรถเข็นสั่งซื้อสินค้า AI จะอ่านรายการทั้งหมดและสร้างคำสั่งซื้อให้ทันที

หรือถ้าถ่ายรูปโบรชัวร์ท่องเที่ยวในโรงแรม ก็สามารถพูดว่า

“หาทัวร์แบบนี้บน Expedia สำหรับ 6 คน”

Gemini จะนำข้อมูลจากรูปภาพไปค้นหาและจัดการต่อให้อัตโนมัติ พร้อมแสดงสถานะการทำงานผ่าน Notification แบบเรียลไทม์

นี่เป็นการขยายแนวคิด “Circle to Search” เดิม ไปสู่ระบบที่เข้าใจภาพและลงมือทำงานต่อได้จริง

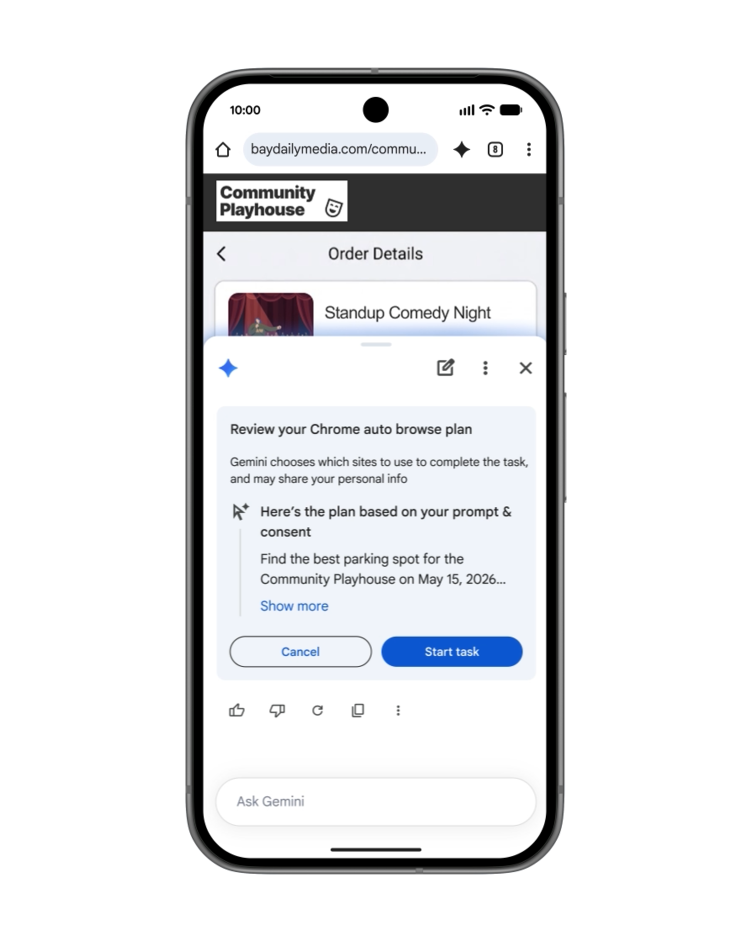

Gemini เข้า Chrome ช่วยสรุปเว็บและจองบริการแทน

Google เตรียมนำ Gemini เข้ามาอยู่ใน Chrome บน Android ตั้งแต่ปลายเดือนมิถุนายนนี้

ความสามารถหลักจะมีทั้ง

• สรุปเนื้อหาเว็บไซต์

• เปรียบเทียบข้อมูลหลายเว็บ

• ช่วยค้นคว้าข้อมูล

• จองนัดหมาย

• จองที่จอดรถ

• ทำงาน Routine บางอย่างแทนผู้ใช้

เรียกได้ว่า Chrome จะเริ่มกลายเป็น “AI Browser Assistant” มากขึ้น แทนที่จะเป็นเพียงเว็บเบราว์เซอร์ธรรมดา

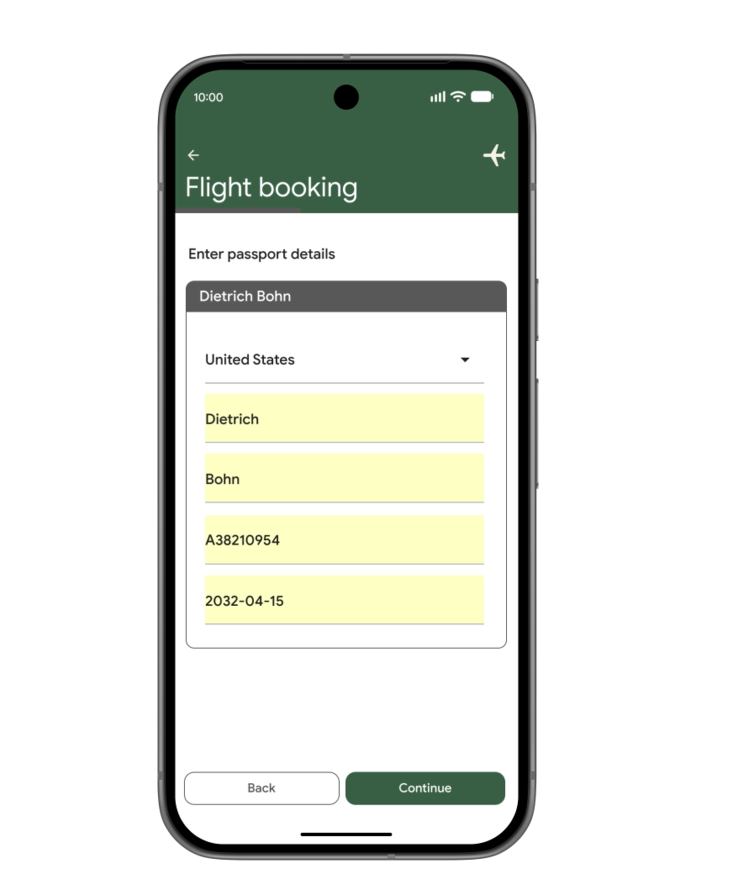

Autofill รุ่นใหม่ กรอกฟอร์มแทบทั้งหมดให้เอง

Google ยังอัปเกรด Autofill with Google ให้ฉลาดขึ้นด้วย Gemini Personal Intelligence

จุดต่างสำคัญคือ เดิม Autofill จะช่วยจำแค่

• ชื่อ

• ที่อยู่

• เบอร์โทร

• รหัสผ่าน

แต่เวอร์ชันใหม่จะสามารถดึงข้อมูลจากแอปต่างๆ ที่เชื่อมไว้มาเติมฟอร์มซับซ้อนให้ได้เอง

เช่น

• ข้อมูลการเดินทาง

• รายละเอียดการสั่งซื้อ

• เอกสารที่เกี่ยวข้อง

• ข้อมูลจากอีเมล

Google ย้ำว่าระบบนี้เป็นแบบ “Opt-in” ทั้งหมด หมายความว่าผู้ใช้ต้องเปิดใช้งานเอง และสามารถปิดได้ทุกเมื่อผ่าน Settings

Rambler ฟีเจอร์ใหม่ เปลี่ยน “พูดมั่วๆ” ให้กลายเป็นข้อความสวยงาม

อีกฟีเจอร์ที่น่าสนใจมากคือ “Rambler” บน Gboard

Google มองว่าปัญหาของ Voice Typing ปัจจุบันคือ “คนพูดไม่เหมือนคนพิมพ์”

เวลาพูดจริง คนเรามักจะ

• พูดซ้ำ

• พูดวก

• มีคำติดปาก

• เว้นจังหวะ

• คิดไปพูดไป

Rambler จะใช้ Gemini ช่วย “เรียบเรียงใหม่” ให้กลายเป็นข้อความที่อ่านง่ายขึ้นโดยอัตโนมัติ

เช่น จากการพูดแบบธรรมชาติ AI อาจสรุปออกมาเป็นข้อความที่กระชับและเป็นทางการขึ้น โดยยังคงใจความเดิมไว้

Google ยังบอกว่า Rambler รองรับการสลับหลายภาษาในประโยคเดียว เช่น พูดไทยปนอังกฤษ หรืออังกฤษปนฮินดี ได้แบบเข้าใจบริบทจริง

นี่น่าจะเป็นหนึ่งในฟีเจอร์ที่มีผลกับผู้ใช้เอเชียมาก เพราะการพูดปนหลายภาษาเป็นเรื่องปกติในชีวิตประจำวัน

Create My Widget สร้าง Widget ด้วยภาษาคน

Android ยังเพิ่มระบบ “Create My Widget” ที่ใช้ Gemini สร้าง Widget แบบกำหนดเองผ่านภาษาธรรมชาติ

ตัวอย่างเช่น

• “แนะนำเมนู High Protein ทุกสัปดาห์”

• “ทำ Widget แสดงความเร็วลมกับฝนเท่านั้น”

• “สรุปตารางออกกำลังกายประจำวัน”

Gemini จะสร้าง Widget ขึ้นมาอัตโนมัติ พร้อมปรับขนาดและวางบน Home Screen ได้ทันที

Google บอกว่านี่คือก้าวแรกของ “Generative UI” บน Android หรือการที่ AI เริ่มสร้างหน้าตา Interface ให้เหมาะกับผู้ใช้แต่ละคนเอง

Material 3 Expressive เวอร์ชันใหม่ เน้นลดสิ่งรบกวน

Gemini Intelligence ยังมาพร้อมดีไซน์ใหม่ที่ต่อยอดจาก Material 3 Expressive

Google ระบุว่าการออกแบบใหม่นี้ไม่ได้เน้นแค่ความสวยงาม แต่ถูกสร้างมาเพื่อลดสิ่งรบกวนสายตา และช่วยให้ผู้ใช้โฟกัสกับงานสำคัญมากขึ้น

รวมถึง Animation ต่างๆ จะถูกออกแบบให้ “มีเหตุผล” มากกว่าเดิม ไม่ใช่แค่เอฟเฟกต์เพื่อความสวยงาม

สิ่งที่ Google กำลังทำ ไม่ใช่แค่ “ใส่ AI” แต่คือเปลี่ยนวิธีใช้มือถือ

สิ่งที่น่าสนใจที่สุดของ Gemini Intelligence คือ Google ไม่ได้มอง AI เป็น “ฟีเจอร์เสริม” อีกต่อไป แต่กำลังเปลี่ยน Android ทั้งระบบให้กลายเป็นผู้ช่วยส่วนตัวแบบเต็มรูปแบบ

จากเดิมที่ผู้ใช้ต้อง

• เปิดแอปเอง

• ค้นหาเอง

• คัดลอกข้อมูลเอง

• กรอกฟอร์มเอง

อนาคต Android กำลังพยายามให้ผู้ใช้ “สั่งเป้าหมาย” แล้วปล่อยให้ AI จัดการขั้นตอนทั้งหมดแทน

คำถามสำคัญต่อจากนี้คือ

• ผู้ใช้จะไว้ใจให้ AI ทำงานแทนมากแค่ไหน

• นักพัฒนาแอปจะเปิดสิทธิ์ให้ AI เข้าถึงระบบมากขึ้นหรือไม่

• และ Apple จะตอบโต้แนวคิดนี้อย่างไรใน iOS รุ่นถัดไป

เพราะสิ่งที่ Google กำลังผลักดัน อาจเป็นจุดเริ่มต้นของยุคที่ “มือถือไม่ได้เป็นแค่อุปกรณ์” แต่กลายเป็นระบบผู้ช่วยอัจฉริยะที่ทำงานแทนเจ้าของได้จริง

รายละเอียดเพิ่มเติม : blog.google